Anthropic presentó dos demandas contra el gobierno de Estados Unidos tras ser señalada por el Pentágono como “riesgo de seguridad nacional” por negarse a retirar límites sobre vigilancia masiva y armas autónomas.

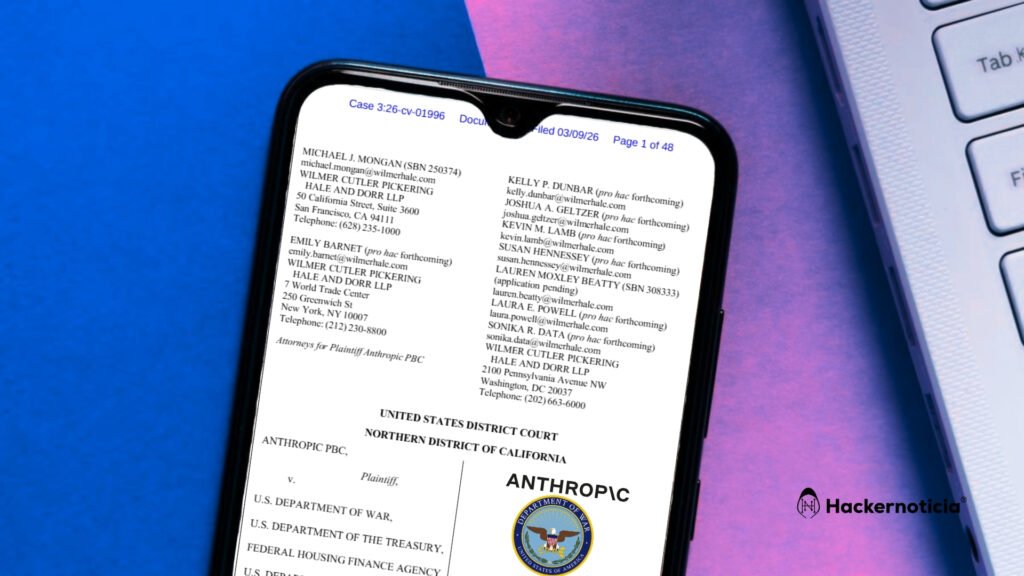

Anthropic demanda al Pentágono y a otras agencias federales después de que el Departamento de Defensa (DoW) de Estados Unidos designara a la empresa de inteligencia artificial formalmente como supply chain risk, una etiqueta considera ilegal y represalia por negarse a permitir usos ilimitados de su IA para la vigilancia masiva doméstica y en entornos bélicos para el control de armas autónomas. La compañía presentó dos acciones judiciales este 9 de marzo: una en California y otra ante el circuito federal de Washington D.C.

El choque entre Anthropic y el gobierno estadounidense no empezó con las demandas. Durante semanas, la empresa y el Pentágono negociaron sin éxito una actualización contractual para el uso de Claude, el modelo de IA de la compañía. El punto de ruptura fueron dos límites que Anthropic quiso mantener: que su tecnología no se use para vigilancia masiva de ciudadanos estadounidenses y que tampoco se despliegue en armas letales totalmente autónomas. El Pentágono rechazó esas restricciones y defendió que la herramienta debe poder usarse para “todos los fines lícitos”.

La designación que escaló el conflicto

La designación como “riesgo para la cadena de suministro” fue formalizada la semana pasada y, según Reuters, es la primera vez que este mecanismo se usa contra una empresa estadounidense. Ese rótulo afecta la posibilidad de que contratistas y socios del gobierno mantengan relaciones comerciales ligadas al Departamento de Defensa con Anthropic, lo que convierte la decisión en una amenaza directa para el desarrollo de su negocio.

En su demanda, Anthropic sostiene que la administración Trump está castigando a la compañía por negarse a aceptar exigencias ideológicas y por ejercer discurso protegido por la Primera Enmienda. También alega vulneraciones al debido proceso y cuestiona la autoridad del gobierno para ordenar a agencias federales dejar de usar Claude en esos términos. La empresa calificó las medidas como “sin precedentes” e “ilegales”.

La respuesta política desde la Casa Blanca endureció todavía más el tono del conflicto. Una portavoz presidencial afirmó que Trump no permitirá que una empresa “woke” dicte cómo opera el ejército, mientras el entorno del secretario de Defensa, Pete Hegseth, defendió que los militares deben conservar acceso a tecnología crítica para cualquier uso permitido por la ley.

Claude ya estaba integrado en sistemas sensibles

El caso tiene peso porque Anthropic no era un actor marginal dentro del ecosistema de defensa. Según The Guardian y AP, Claude había sido integrado en sistemas del Departamento de Defensa durante el último año y, hasta hace poco, era el único modelo de IA aprobado para ciertos entornos clasificados. Anthropic insiste en que no rechaza trabajar con el gobierno en seguridad nacional, sino que busca mantener dos líneas rojas concretas.

Esa posición es central para entender la disputa. Anthropic no está planteando una retirada total del sector defensa; está intentando conservar capacidad contractual sin renunciar a límites sobre usos que considera técnica y éticamente inseguros. Su CEO, Dario Amodei, ha defendido públicamente que la IA actual no es lo bastante confiable para armas autónomas y que la vigilancia masiva de ciudadanos plantea objeciones constitucionales y de seguridad.

Un caso que va más allá de Anthropic

La importancia de esta noticia no está solo en las demandas. El caso muestra hasta qué punto la relación entre grandes empresas de IA y aparatos de defensa se está tensando alrededor de una pregunta más amplia: quién define los límites de uso de estos sistemas cuando ya forman parte de infraestructura estatal sensible. La designación contra Anthropic no es una disputa contractual ordinaria; puede convertirse en precedente sobre si el gobierno puede castigar comercialmente a una compañía tecnológica por intentar imponer salvaguardas y garantías para evitar la vigilancia doméstica estatal o letalidad autónoma en conflictos bélicos.

También deja ver un reordenamiento del mercado. Mientras Anthropic se enfrenta al Pentágono, OpenAI avanzó en un acuerdo con el Departamento de Defensa, lo que subraya que la competencia entre empresas de IA ya no se juega solo en capacidades técnicas o consumo masivo, sino también en disposición para aceptar condiciones de uso militar y estatal.

A corto plazo, el proceso judicial definirá si Anthropic logra suspender o revertir la designación. Asimismo, el caso abre una discusión más profunda sobre gobernanza tecnológica: si las salvaguardas que una empresa incorpora a sus modelos pueden sobrevivir cuando chocan con los intereses operativos del Estado. Por ahora, Anthropic demanda al Pentágono para frenar una medida que considera punitiva, mientras Washington intenta dejar claro que el uso militar de la IA no quedará sujeto a las líneas rojas de un proveedor privado.

Mantente al día con las últimas noticias de inteligencia artificial en @Hackernoticia a través de nuestras redes sociales.